Os desafios éticos da IA na programação revelam como códigos podem refletir nossos próprios vieses. Vamos explorar o que está por trás dessas linhas de comando.

Como os vieses algorítmicos escondem discriminações nos sistemas de decisão

Eu já vi sistemas que pareciam neutros, mas na prática perpetuavam desigualdades. O código não mente – ele apenas reproduz o que aprendeu com dados enviesados.

Fica tranquila: identificar esses vieses é o primeiro passo para corrigi-los. Equipes multidisciplinares são essenciais aqui, pois trazem perspectivas que programadores sozinhos podem ignorar.

Auditorias periódicas desses algoritmos garantem que sua aplicação seja justa e segura. Você não quer um sistema que toma decisões baseadas em preconceitos, certo?

Em Destaque 2026: Os principais desafios éticos na programação com IA incluem a gestão de vieses, a transparência dos modelos e a responsabilidade jurídica por erros automatizados.

Desafios éticos da IA na programação: o que os códigos escondem sobre você?

No universo da programação, a inteligência artificial (IA) abriu portas para inovações incríveis, mas também levantou questões éticas complexas. Como desenvolvedor, você precisa entender que o código que escrevemos não é neutro. Ele reflete nossos valores e, sem cuidado, pode perpetuar preconceitos. Vamos mergulhar nos desafios que a IA traz para a ética na programação.

| Aspecto | Descrição |

|---|---|

| Vieses Algorítmicos | IA pode amplificar discriminações existentes. |

| Transparência | Modelos opacos dificultam a identificação de falhas. |

| Privacidade | Coleta massiva de dados gera preocupações. |

| Responsabilidade | Definir quem responde por erros de IA é um desafio. |

| Propriedade Intelectual | IA generativa levanta questões de originalidade. |

| Dependência Tecnológica | Risco de perda de habilidades humanas essenciais. |

Principais Dilemas Éticos da IA na Programação: Um Panorama Atual

A inteligência artificial, quando aplicada ao desenvolvimento de software, introduz um leque de dilemas éticos que exigem atenção redobrada. Vieses algorítmicos, por exemplo, são um dos problemas mais recorrentes. Eles podem perpetuar ou até amplificar discriminações em sistemas de decisão, afetando diretamente a vida das pessoas. A falta de transparência em muitos modelos de IA também é um gargalo, dificultando a identificação e correção de erros. Imagine um sistema de crédito que nega empréstimos com base em dados enviesados; a dificuldade em auditar o código-fonte desse sistema pode deixar muitos sem acesso a oportunidades.

A coleta massiva de dados, essencial para treinar esses modelos, levanta sérias preocupações sobre privacidade. O que acontece com as informações que alimentam a IA? Quem tem acesso a elas? Essas são perguntas cruciais. Além disso, determinar a responsabilidade por erros cometidos por código gerado por IA é um campo minado. Se um carro autônomo causa um acidente, a culpa é do programador, da empresa, ou da própria IA?

Como Implementar a Programação Ética em Sistemas de IA

Adotar uma abordagem ética na programação de IA não é uma opção, é uma necessidade. A integração de princípios éticos deve ocorrer em todas as fases do ciclo de vida do software, desde o design inicial até a manutenção. Isso significa pensar nas implicações de cada linha de código. A velocidade de desenvolvimento com IA, embora tentadora, nem sempre garante a qualidade e a segurança necessárias. É fundamental que as equipes estejam atentas a isso.

A IA pode ser uma ferramenta poderosa, mas seu uso ético depende da consciência e das escolhas de quem a desenvolve.

Para garantir que os sistemas sejam justos e seguros, auditorias periódicas de algoritmos são indispensáveis. Elas ajudam a identificar e corrigir comportamentos indesejados antes que causem danos. Lembre-se: a programação ética é um processo contínuo, não um destino final.

Responsabilidade em IA: Quem é Responsável Pelas Decisões dos Algoritmos?

A questão da responsabilidade por erros em código gerado por IA é um dos maiores desafios éticos que enfrentamos hoje. Quando um algoritmo toma uma decisão errada, com consequências negativas, é difícil apontar um único culpado. A complexidade dos modelos, muitas vezes caixas-pretas, torna a atribuição de culpa um quebra-cabeça. Precisamos de frameworks claros para lidar com isso.

A colaboração entre juristas, éticos e engenheiros de software é vital para estabelecer diretrizes sobre responsabilidade. A UNESCO, por exemplo, tem discutido ativamente a necessidade de regulamentações para a IA, buscando um equilíbrio entre inovação e proteção.

Transparência em Algoritmos: Por Que é Essencial e Como Garanti-la

A falta de transparência em modelos de IA é um obstáculo significativo para a confiança e a auditoria. Quando não entendemos como um algoritmo chega a uma determinada conclusão, fica difícil confiar nele, especialmente em aplicações críticas. Precisamos de modelos mais interpretáveis.

Garantir a transparência envolve documentar o processo de desenvolvimento, os dados utilizados e as decisões de design. Técnicas como a explicabilidade da IA (XAI) buscam tornar os modelos mais compreensíveis para humanos. Isso é crucial para identificar vieses e garantir que os sistemas operem de forma justa.

Viés em IA: Identificando e Mitigando Preconceitos nos Sistemas

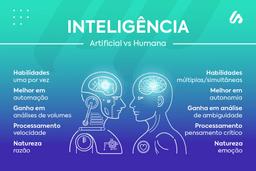

Vieses em IA são um reflexo dos vieses presentes nos dados com os quais treinamos os modelos. Se os dados históricos refletem discriminações passadas, a IA aprenderá e perpetuará esses preconceitos. Identificar esses vieses requer um olhar crítico e atento. A formação de equipes multidisciplinares é essencial nesse processo, pois diferentes perspectivas ajudam a detectar preconceitos que poderiam passar despercebidos por um grupo homogêneo.

Mitigar vieses envolve desde a curadoria cuidadosa dos dados de treinamento até o uso de técnicas algorítmicas para reduzir a discriminação. É um trabalho contínuo de refinamento e validação. A programação ética em IA exige que combatamos ativamente esses preconceitos.

Desafios Éticos da IA na Tomada de Decisão Automatizada

Sistemas de IA estão cada vez mais envolvidos em tomadas de decisão que afetam diretamente a vida das pessoas, desde contratações até diagnósticos médicos. A velocidade com que a IA opera pode ser vantajosa, mas nem sempre garante a qualidade e a segurança dessas decisões. É fundamental que haja supervisão humana e mecanismos de revisão.

O uso de IA generativa em código, por exemplo, levanta questões sobre originalidade e propriedade intelectual. Se a IA cria um trecho de código, quem é o autor? A quem ele pertence? Essas são discussões que estão apenas começando.

Estratégias Práticas para Desenvolver uma IA Ética e Responsável

Para construir uma IA ética e responsável, precisamos de um plano de ação claro. A primeira linha de defesa é a conscientização. Todos na equipe devem entender os riscos éticos envolvidos. Em seguida, a implementação de diretrizes claras e processos de revisão é fundamental. A alura oferece ótimos conteúdos sobre como abordar a ética em IA.

Priorize a segurança e a justiça sobre a mera velocidade de entrega. Um código ético é um código mais robusto a longo prazo.

O teste contínuo e a auditoria dos sistemas são cruciais. Devemos sempre buscar feedback e estar abertos a corrigir falhas. A colaboração com especialistas em ética e direito também enriquece o processo.

O Papel dos Programadores nos Desafios Éticos da Inteligência Artificial

Como programadores, temos um papel central na mitigação dos desafios éticos da IA. Somos nós que escrevemos o código e tomamos decisões de design que moldam o comportamento dos sistemas. A IA pode levar à dependência tecnológica e à perda de habilidades humanas críticas se não formos cuidadosos. Precisamos usar a IA como uma ferramenta para aprimorar nossas capacidades, não para substituí-las cegamente.

A responsabilidade de garantir que a IA seja usada para o bem recai, em grande parte, sobre nós. Isso exige aprendizado contínuo, um compromisso com a ética e a disposição para questionar e aprimorar nossos próprios códigos e os sistemas que criamos. O futuro da IA ética está em nossas mãos.

Benefícios e Desafios Reais da IA na Programação

- Benefício: Aumento da produtividade e eficiência no desenvolvimento de software.

- Desafio: Vieses algorítmicos podem perpetuar ou amplificar discriminações em sistemas de decisão.

- Benefício: Automação de tarefas repetitivas, liberando programadores para atividades mais estratégicas.

- Desafio: A falta de transparência em modelos de IA dificulta a identificação de erros.

- Benefício: Capacidade de analisar grandes volumes de dados para insights valiosos.

- Desafio: Coleta massiva de dados para treinamento de IA levanta preocupações sobre privacidade.

- Benefício: Criação de novas aplicações e serviços inovadores.

- Desafio: Determinar a responsabilidade por erros em código gerado por IA é um desafio.

- Desafio: O uso de IA generativa em código levanta questões de originalidade e propriedade intelectual.

- Desafio: A IA pode levar à dependência tecnológica e à perda de habilidades humanas críticas.

- Desafio: A velocidade de desenvolvimento com IA nem sempre garante qualidade e segurança.

Mitos e Verdades sobre os Desafios Éticos da IA na Programação

Mito: A IA é inerentemente neutra e imparcial. Verdade: A IA reflete os vieses presentes nos dados de treinamento e nas decisões de seus criadores. Vieses algorítmicos podem perpetuar ou amplificar discriminações.

Mito: A transparência total em modelos de IA é sempre possível e desejável. Verdade: Embora a transparência seja crucial, alguns modelos complexos apresentam desafios técnicos para uma explicabilidade completa. A falta de transparência em modelos de IA dificulta a identificação de erros.

Mito: A responsabilidade por erros de IA é sempre clara e direta. Verdade: Determinar a responsabilidade por erros em código gerado por IA é um desafio complexo, envolvendo múltiplos atores.

Mito: IA generativa em código é uma solução mágica para a criação de software. Verdade: O uso de IA generativa em código levanta questões de originalidade e propriedade intelectual, exigindo cautela e revisão humana.

Mito: A automação via IA elimina a necessidade de habilidades humanas críticas. Verdade: A IA pode levar à dependência tecnológica e à perda de habilidades humanas críticas se não for gerenciada corretamente. A integração de princípios éticos deve ocorrer em todas as fases do ciclo de vida do software.

Mito: A velocidade de desenvolvimento com IA garante software de alta qualidade. Verdade: A velocidade de desenvolvimento com IA nem sempre garante qualidade e segurança. Equipes multidisciplinares são essenciais para identificar vieses em IA, e auditorias periódicas de algoritmos são necessárias para garantir justiça e segurança.

Dicas Extras: Ações Práticas para Hoje Mesmo

Fica tranquila, você não precisa virar um filósofo da tecnologia. Comece com essas ações simples que já fazem uma diferença enorme no seu dia a dia de código.

- Revise sempre os dados de treinamento: Antes de rodar qualquer modelo, dê uma olhada crítica nos dados. Pergunte-se: ‘Essa amostra representa todo mundo que vai usar o sistema?’ É o primeiro passo para evitar vieses.

- Documente suas decisões de código: Quando usar uma IA generativa para escrever um trecho, anote no comentário o ‘porquê’ daquela escolha. Isso cria um rastro de transparência para você e sua equipe.

- Faça um ‘teste de senso comum’: Depois que a IA sugerir uma solução, pare e pense: ‘Isso faz sentido no mundo real?’ Não aceite o código cegamente. Sua experiência humana é insubstituível.

- Estabeleça um checkpoint de ética: Inclua uma etapa rápida de revisão ética no seu fluxo de desenvolvimento. Pode ser uma simples pergunta no pull request: ‘Identificamos algum risco potencial de discriminação aqui?’

- Converse com pessoas de outras áreas: Bate um papo rápido com alguém de RH, jurídico ou do comercial sobre o sistema que você está criando. A perspectiva externa revela vieses que a gente, dentro da bolha técnica, não enxerga.

Perguntas Frequentes sobre Ética na IA

Quem é responsável quando um código gerado por IA causa um erro?

Em última instância, a responsabilidade é sempre do desenvolvedor ou da empresa que implementou e colocou o sistema no ar. A IA é uma ferramenta, não uma entidade legal. O desafio é que, com a falta de transparência em alguns modelos, fica difícil rastrear a origem exata do problema, mas a culpa não ‘some’ magicamente.

Como evitar que minha IA seja preconceituosa?

Você evita vieses começando pelos dados. Use conjuntos de treinamento diversos e representativos da realidade. Além disso, teste o sistema com cenários específicos para grupos marginalizados e monitore os resultados de forma contínua. Não existe ‘setar e esquecer’ quando o assunto é justiça algorítmica.

Vale a pena o custo de implementar práticas éticas de IA?

Vale, e muito. O custo de *não* implementar é infinitamente maior. Pense em multas por vazamento de dados, processos judiciais por discriminação, perda de reputação da marca e a necessidade de refazer sistemas inteiros. Investir em ética desde o início é economia de tempo, dinheiro e dor de cabeça no futuro.

O Código do Futuro é Humano

Pois é, a revolução da IA na programação chegou, mas ela não apagou a nossa responsabilidade. Pelo contrário, trouxe ela para o centro do palco. Você viu que os desafios são reais: desde vieses escondidos nos dados até a complexa questão de quem responde pelos erros. Mas também viu que as soluções estão ao seu alcance, com dicas práticas que você pode aplicar hoje.

A transformação aqui é clara: de meros escritores de código, estamos nos tornando arquitetos de sistemas conscientes. Nossa função agora é garantir que a inteligência da máquina reflita o melhor da humanidade – justiça, transparência e responsabilidade.

O seu primeiro passo? Escolha uma das dicas extras e implemente no seu próximo projeto. Pode ser só a documentação das decisões ou uma rápida revisão dos dados. O importante é começar.

Este assunto é crucial. Compartilhe este artigo com alguém da sua equipe e comecem essa conversa. E para você, qual é o maior dilema ético que já encontrou programando com IA? Conta pra gente nos comentários!