Você está se perguntando o que é o robots.txt e como ele pode turbinar seu site em 2026? Muitos donos de sites sofrem com páginas que não aparecem nos resultados de busca ou com o Google demorando muito para encontrar o conteúdo novo. A boa notícia é que este arquivo simples pode ser seu maior aliado para guiar os robôs dos buscadores e garantir que seu site seja visto da melhor forma possível. Vou te mostrar exatamente como ele funciona e como você pode usá-lo a seu favor.

Como o Robots.txt Guia os Robôs dos Buscadores para o Seu Site

Pense no robots.txt como um porteiro do seu site. Ele conversa com os robôs de busca, como o Googlebot, dizendo quais portas eles podem abrir e quais devem ficar fechadas.

Isso evita que eles percam tempo em áreas que não interessam, como páginas de login ou conteúdo duplicado.

Ao direcionar os robôs para as páginas certas, você otimiza o tempo que eles gastam no seu site. Isso é crucial, especialmente para sites grandes.

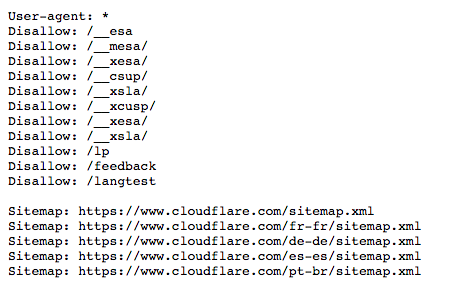

Seu robots.txt pode, inclusive, apontar o caminho para o sitemap do seu site, facilitando a descoberta de todo o conteúdo importante.

“O robots.txt é um arquivo de texto simples, localizado na raiz do seu site, que serve para dar instruções aos robôs dos motores de busca (como o Googlebot) sobre quais páginas ou pastas eles podem ou não rastrear, impactando diretamente o orçamento de rastreamento (Crawl Budget).”

O Que é o robots.txt e Para Que Serve? O Guia Essencial para SEO em 2026

No universo do marketing digital, cada detalhe conta para garantir que seu site seja encontrado e bem posicionado nos mecanismos de busca. E, acredite, o arquivo robots.txt é um desses detalhes cruciais que muitos negligenciam. Ele é, na prática, um guia de instruções para os robôs de rastreamento, como o Googlebot, determinando quais partes do seu site eles podem ou não visitar e indexar. Pense nele como um porteiro digital, controlando o acesso e otimizando a jornada dos buscadores pelo seu conteúdo.

Entender e configurar corretamente o robots.txt é fundamental para o sucesso do seu SEO. Ele não apenas ajuda a direcionar os esforços dos robôs para as páginas mais importantes, mas também evita que conteúdos duplicados ou irrelevantes sejam indexados, o que pode prejudicar seu ranking. Vamos combinar, ninguém quer que o Google perca tempo com páginas de login ou arquivos temporários, certo? É aí que o robots.txt entra em cena, com sua capacidade de gerenciar o rastreamento e garantir que seu orçamento de rastreamento seja bem utilizado.

Implementar esse arquivo de forma estratégica significa que você está no controle. Está dizendo aos mecanismos de busca exatamente o que você quer que eles vejam e o que prefere manter privado. Para sites muito grandes, com milhares de páginas, essa organização se torna ainda mais vital. O robots.txt, quando bem configurado, pode ser um aliado poderoso para manter seu site limpo, eficiente e otimizado para rankear bem.

| Componente | Descrição |

|---|---|

| Propósito | Instruir robôs de rastreamento sobre quais páginas acessar. |

| Agentes Principais | Googlebot, Bingbot e outros crawlers de mecanismos de busca. |

| Sintaxe | Baseada em diretivas como User-agent, Disallow, Allow e Sitemap. |

| Localização | Na raiz do domínio (ex: seusite.com/robots.txt). |

| Importância para SEO | Gerenciamento do Orçamento de Rastreamento, prevenção de indexação de conteúdo indesejado. |

| Link para Sitemap | Geralmente inclui o link para o sitemap do site. |

O que é o arquivo robots.txt e sua importância para SEO

O arquivo robots.txt é um documento de texto simples, localizado na raiz do seu domínio (por exemplo, www.seusite.com.br/robots.txt). Sua função primária é comunicar às ferramentas de busca quais partes do seu site elas devem ou não rastrear. Isso é crucial para o SEO porque um rastreamento eficiente garante que os mecanismos de busca dediquem seu tempo e recursos às páginas que realmente importam para o seu negócio e para o seu público. Ignorar o robots.txt é como deixar um guia turístico perdido em um museu, sem saber quais obras de arte são as mais valiosas.

Para o SEO, a importância do robots.txt reside em sua capacidade de controlar o acesso e, consequentemente, a indexação. Ao impedir que robôs acessem páginas de baixo valor, como resultados de busca interna, páginas de login ou conteúdo duplicado, você direciona o foco deles para o seu conteúdo principal. Isso otimiza o ‘Orçamento de Rastreamento’ (Crawl Budget), um conceito vital para sites grandes. Um bom uso do robots.txt evita que páginas irrelevantes consumam esse orçamento, garantindo que seu conteúdo de maior valor seja descoberto e indexado mais rapidamente.

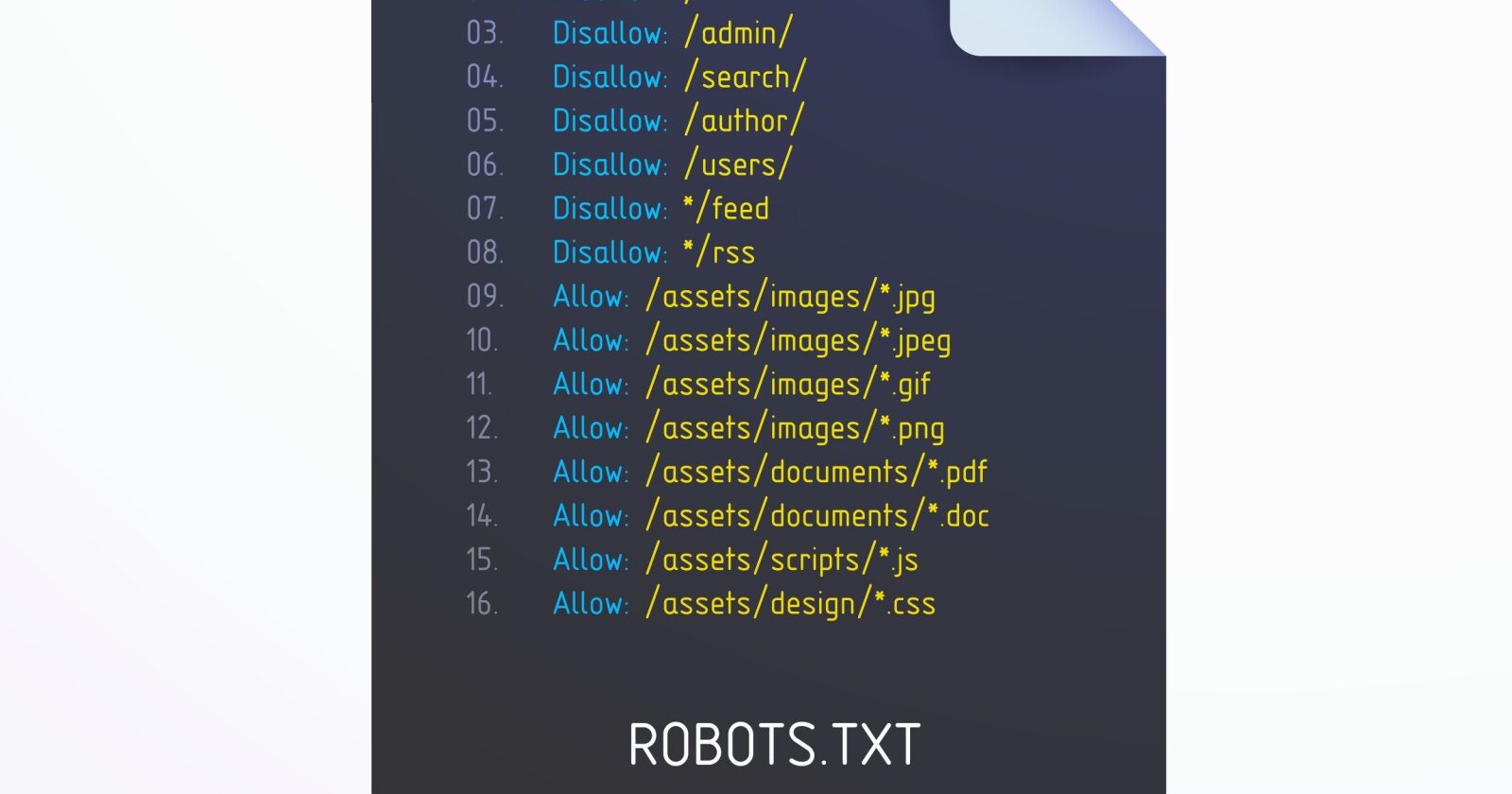

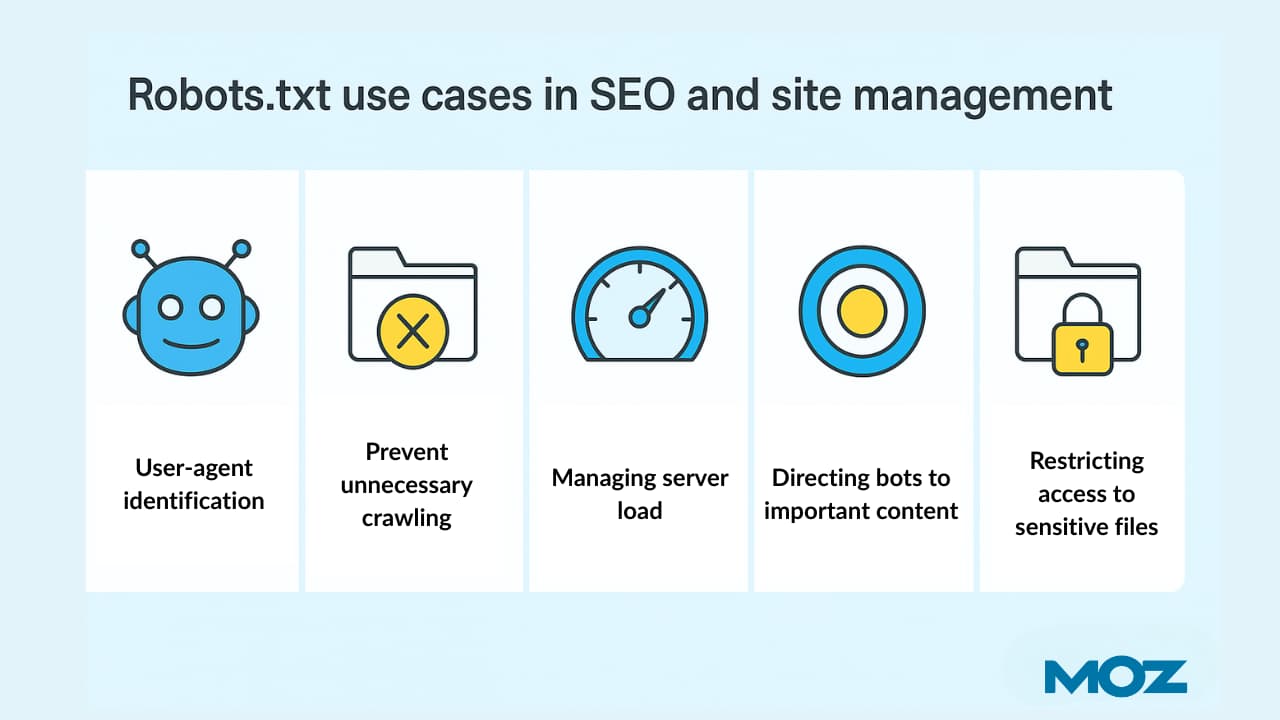

As principais funções do robots.txt no rastreamento de sites

Vamos detalhar as funções essenciais que o robots.txt desempenha. Primeiro, ele atua como um filtro, permitindo que você especifique quais diretórios ou arquivos devem ser ignorados pelos robôs de busca. Essa capacidade de bloqueio é poderosa. Você pode, por exemplo, impedir o rastreamento de páginas de agradecimento após um formulário, que não agregam valor à experiência de busca. Além disso, o robots.txt pode ser usado para evitar que conteúdo duplicado seja indexado, um problema comum em sites com muitas variações de páginas de produto ou conteúdo gerado dinamicamente.

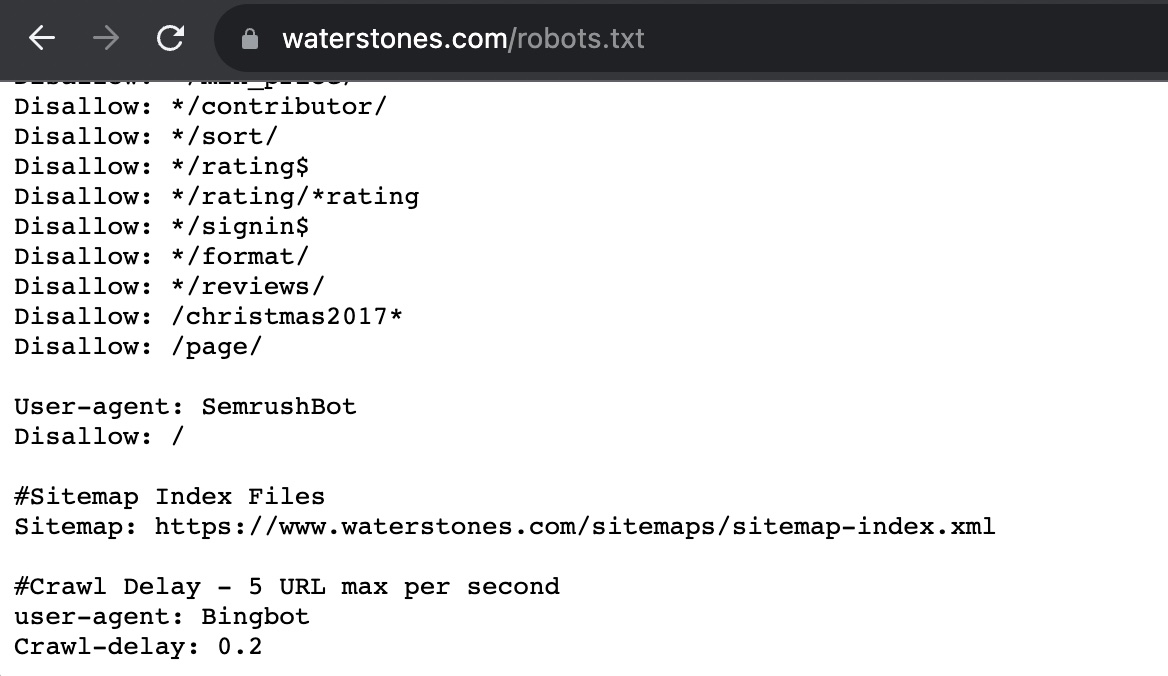

Outra função vital é a inclusão do link para o sitemap do seu site. O sitemap é um mapa detalhado de todas as URLs importantes, e o robots.txt geralmente aponta para ele, facilitando a descoberta e a indexação de todo o seu conteúdo relevante. Fica tranquila, o robots.txt não impede que um usuário acesse uma página bloqueada para robôs; ele apenas informa aos robôs para não a rastrearem. Essa distinção é fundamental para entender como ele se encaixa na sua estratégia de visibilidade online.

Como o robots.txt funciona: Sintaxe e diretivas essenciais

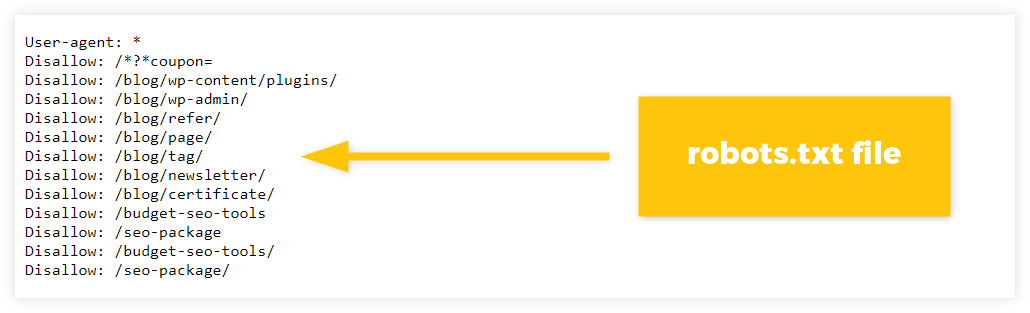

A mágica do robots.txt está em sua sintaxe simples, mas eficaz. Ela se baseia em diretivas que definem regras claras. As mais importantes são ‘User-agent’, que especifica para qual robô a regra se aplica (por exemplo, ‘Googlebot’ ou ‘*’ para todos os robôs), e ‘Disallow’, que indica as URLs ou caminhos que o robô não deve acessar. Existe também a diretiva ‘Allow’, que pode ser usada para permitir o acesso a um subdiretório específico dentro de um caminho que foi previamente bloqueado com ‘Disallow’.

A estrutura é bem direta: você define um ‘User-agent’, seguido pelas regras de ‘Disallow’ e ‘Allow’ para aquele agente. Por exemplo, para bloquear todo o conteúdo de um diretório chamado ‘arquivos_temporarios’ para todos os robôs, você usaria: User-agent: * Disallow: /arquivos_temporarios/. É fundamental entender a sintaxe do robots.txt para evitar erros que podem, ironicamente, prejudicar seu SEO. Um erro comum é usar barras invertidas de forma incorreta ou esquecer de especificar o agente.

Pontos de atenção e mitos sobre o uso do robots.txt

É preciso ter muito cuidado ao configurar o robots.txt, pois um erro pode ter consequências sérias. O principal ponto de atenção é que a diretiva ‘Disallow’ é uma instrução, não uma regra absoluta de segurança. Conteúdo bloqueado pelo robots.txt ainda pode ser indexado se houver links externos apontando para ele, embora sem o benefício de metadados como o título e a descrição. Por isso, para impedir totalmente a indexação, a meta tag noindex é mais eficaz.

Um mito comum é que o robots.txt pode ser usado para ocultar conteúdo sensível. Isso não é verdade. Ele serve apenas para gerenciar o rastreamento. Para informações que precisam ser protegidas, utilize autenticação (senhas) ou outras medidas de segurança. Outro equívoco é achar que um arquivo robots.txt ausente significa que tudo é permitido; na verdade, significa que todos os robôs têm permissão para rastrear todo o site. Ou seja, a ausência do arquivo não é uma estratégia de SEO.

Diferença crucial entre robots.txt e a meta tag noindex

A distinção entre o robots.txt e a meta tag `noindex` é um dos pontos mais importantes para um SEO eficaz. O robots.txt controla o rastreamento, ou seja, se um robô de busca pode ou não visitar uma página. Já a meta tag `noindex`, inserida no código HTML de uma página específica, controla a indexação. Uma página com `noindex` não aparecerá nos resultados de busca, mesmo que o robô tenha tido permissão para rastreá-la.

Vamos combinar: o robots.txt pode ser usado para impedir que páginas de baixo valor (como páginas de admin ou resultados de busca interna) sejam rastreadas. No entanto, se você quer garantir ABSOLUTAMENTE que uma página não apareça no Google, a diretiva Noindex é a ferramenta correta. Usar ambos pode ser redundante ou até contraproducente se não for feito com cuidado. Por exemplo, se você bloqueia uma página no robots.txt, o robô pode nunca a rastrear para ver a meta tag `noindex`, e ela pode acabar sendo indexada de qualquer forma.

Gerenciando o Crawl Budget com um robots.txt otimizado

O Orçamento de Rastreamento, ou Crawl Budget, é a quantidade de recursos que um mecanismo de busca dedica para rastrear seu site. Para sites com um grande volume de páginas, gerenciar esse orçamento é vital. Um robots.txt bem configurado é seu principal aliado aqui. Ao bloquear o acesso a páginas que não agregam valor (como páginas de login, conteúdo duplicado, ou URLs com parâmetros irrelevantes), você garante que os robôs do Google gastem seu tempo rastreamento o que realmente importa: seu conteúdo valioso e otimizado.

Pois é, imagine que o Google tem um tempo limitado para visitar seu site. Se ele passa esse tempo todo em páginas que não vão trazer tráfego ou conversões, seu conteúdo principal pode ficar para depois. O robots.txt direciona esses robôs para as páginas certas, acelerando a descoberta de novas páginas e a atualização de conteúdo existente. Isso impacta diretamente a velocidade com que seu site é indexado e, consequentemente, sua capacidade de rankear bem em 2026.

Exemplos práticos de configuração do robots.txt para diferentes cenários

Vamos ver alguns exemplos práticos que ilustram como você pode usar o robots.txt para diferentes necessidades. Um cenário comum é querer impedir que o Google rastreie subdiretórios específicos. Se você tem um diretório de ‘admin’ e outro de ‘arquivos_temporarios’ que não devem ser indexados, a configuração seria:

User-agent: * Disallow: /admin/ Disallow: /arquivos_temporarios/

Outra situação é querer bloquear um tipo específico de URL, como aquelas que contêm um parâmetro de busca específico, mas permitir o rastreamento de outras partes do site. Para bloquear todas as URLs que contêm ‘?sessionid=’:

User-agent: * Disallow: /*?sessionid=

Se você usa WordPress, existem guias específicos que detalham como gerenciar o robots.txt, muitas vezes através de plugins de SEO ou do próprio painel administrativo. A chave é sempre testar suas regras para garantir que elas funcionem como esperado e não bloqueiem acidentalmente conteúdo importante.

Como criar, testar e implementar o robots.txt corretamente

Criar um arquivo robots.txt é mais simples do que parece. Você pode usar um editor de texto simples (como Bloco de Notas no Windows ou TextEdit no Mac) para escrever as diretivas. Salve o arquivo com o nome exato ‘robots.txt’. O passo crucial é posicioná-lo na raiz do seu domínio. Se o seu site é www.seusite.com.br, o arquivo deve estar em www.seusite.com.br/robots.txt.

Antes de implementar, é essencial testar. Ferramentas como o Google Search Console oferecem um testador de robots.txt que simula como o Googlebot interpretaria suas regras. Isso ajuda a identificar erros de sintaxe ou bloqueios indesejados. Após os testes, faça o upload do arquivo para a raiz do seu servidor. Lembre-se que o robots.txt geralmente inclui o link para o sitemap, então verifique se essa informação está correta e acessível.

Vale a Pena Investir Tempo no Robots.txt?

Vamos combinar, em 2026, negligenciar o arquivo robots.txt é um erro estratégico que pode custar caro em termos de visibilidade online. Investir tempo para entender e configurar corretamente suas diretivas não é apenas uma boa prática de SEO, é um investimento direto na eficiência do rastreamento do seu site e, por consequência, no seu potencial de rankeamento.

O resultado esperado de um robots.txt bem otimizado é claro: um site mais limpo nos olhos dos mecanismos de busca, com conteúdo relevante sendo descoberto e indexado mais rapidamente. Isso se traduz em melhor performance nos rankings, mais tráfego orgânico qualificado e, em última análise, um ROI mais alto para seus esforços de marketing digital. Fica tranquila, o esforço é mínimo comparado ao ganho de controle e otimização que você obtém.

Dicas Extras

- Teste seu robots.txt: Antes de publicar, use ferramentas para verificar se há erros de sintaxe ou bloqueios indesejados. Ferramentas essenciais para testar seu Robots.txt são suas aliadas.

- Entenda o Crawl Budget: Para sites grandes, o robots.txt é crucial para guiar os robôs de busca a focar nas páginas importantes, otimizando seu orçamento de rastreamento.

- robots.txt e SEO: Use o arquivo para impedir que páginas duplicadas ou de baixo valor sejam rastreadas, concentrando o poder de rastreamento nas suas páginas de maior relevância.

- robots.txt no WordPress: Se você usa WordPress, plugins de SEO geralmente oferecem uma interface para gerenciar seu robots.txt sem precisar editar o arquivo diretamente.

Dúvidas Frequentes

O que é o robots.txt e para que serve?

O robots.txt é um arquivo de texto simples que você coloca na raiz do seu site. Ele serve para instruir os robôs de busca, como o Googlebot, sobre quais páginas ou seções do seu site eles não devem rastrear ou indexar. É uma ferramenta fundamental para o SEO.

Como criar um robots.txt?

Você cria um arquivo chamado ‘robots.txt’ e o envia para o diretório raiz do seu site. Dentro dele, usa diretivas como ‘User-agent’ para especificar qual robô você está se dirigindo e ‘Disallow’ para indicar o que ele não deve acessar. Para sites em WordPress, plugins de SEO facilitam esse processo.

Devo bloquear páginas com o robots.txt?

Sim, você pode usar o robots.txt para bloquear páginas que não agregam valor para o SEO, como páginas de login, resultados de busca interna do seu site ou conteúdo duplicado. Isso ajuda a otimizar o crawl budget do seu site, garantindo que os robôs priorizem seu conteúdo principal.

Conclusão

Dominar o robots.txt é um passo estratégico para qualquer um que busca otimizar a presença online em 2026. Ao controlar o acesso dos robôs, você garante que os mecanismos de busca direcionem seus esforços para o conteúdo mais valioso do seu site. Lembre-se de que este arquivo é apenas uma parte do quebra-cabeça do SEO. Explorar um Guia Completo de Sitemap XML para SEO e entender Noindex vs Nofollow: Qual Usar e Quando? são passos lógicos para aprimorar ainda mais sua performance.