Você busca otimizar sua API com cache http para performance de api? A lentidão nas respostas é um problema comum que frustra usuários e prejudica a escalabilidade. Muitas vezes, a solução está em como gerenciamos as requisições e respostas. Neste artigo, eu vou te mostrar como usar o cache de forma inteligente para turbinar a velocidade da sua API, algo essencial em 2026.

Como o Cache HTTP Impulsiona a Performance de APIs em Tempo Real?

Vamos combinar, ninguém gosta de esperar. O cache HTTP é uma ferramenta poderosa para acelerar APIs. Ele armazena cópias de respostas para que não precisemos buscá-las repetidamente. Isso significa menos trabalho para o seu servidor e respostas mais rápidas para o usuário.

Existem várias camadas onde o cache pode atuar. Cada uma com seu papel fundamental na agilidade do seu sistema.

“O uso de cache HTTP é uma das estratégias mais eficazes para otimizar a performance de APIs, permitindo a reutilização de respostas e reduzindo a necessidade de processamento repetido no servidor ou transferência redundante de dados pela rede.”

Cache HTTP: Acelere Sua API Como Um Profissional

No universo das APIs, a velocidade é rei. Cada milissegundo conta para garantir uma experiência fluida ao usuário e manter sua aplicação competitiva. É aqui que o cache HTTP entra em cena, atuando como um verdadeiro turbo para a performance. Pense nele como um assistente inteligente que armazena respostas de requisições frequentes, evitando que seu servidor precise processar tudo do zero a cada nova solicitação.

Implementar um cache HTTP eficaz não é apenas uma otimização; é uma estratégia fundamental para escalabilidade e eficiência. Ao reduzir a carga no servidor de origem e diminuir a latência, você não só melhora o tempo de resposta, mas também economiza recursos preciosos, como banda e poder de processamento. Vamos desmistificar como essa tecnologia funciona e como você pode aplicá-la para levar sua API a outro patamar.

| Característica | Descrição |

|---|---|

| Propósito Principal | Acelerar o acesso a dados e recursos da API |

| Mecanismo Chave | Armazenamento temporário de respostas de requisição |

| Tipos Comuns | Cache do cliente, proxies intermediários, cache do servidor |

| Cabeçalhos Essenciais | Cache-Control, ETag, Last-Modified |

| Benefícios Primários | Redução de latência, escalabilidade, economia de custos |

Principais Mecanismos de Cache HTTP

O cache HTTP opera através de um conjunto de regras e cabeçalhos que definem como e por quanto tempo as respostas podem ser armazenadas e reutilizadas. Essa inteligência permite que clientes e intermediários sirvam conteúdo sem precisar consultar o servidor de origem repetidamente. Compreender esses mecanismos é o primeiro passo para uma otimização de performance de API com cache HTTP bem-sucedida.

A comunicação entre cliente e servidor é orquestrada por meio de cabeçalhos HTTP específicos. Eles funcionam como instruções, ditando o comportamento do cache. Quando configurados corretamente, esses cabeçalhos garantem que as informações mais relevantes sejam servidas rapidamente, sem comprometer a integridade dos dados.

Cabeçalho Cache-Control

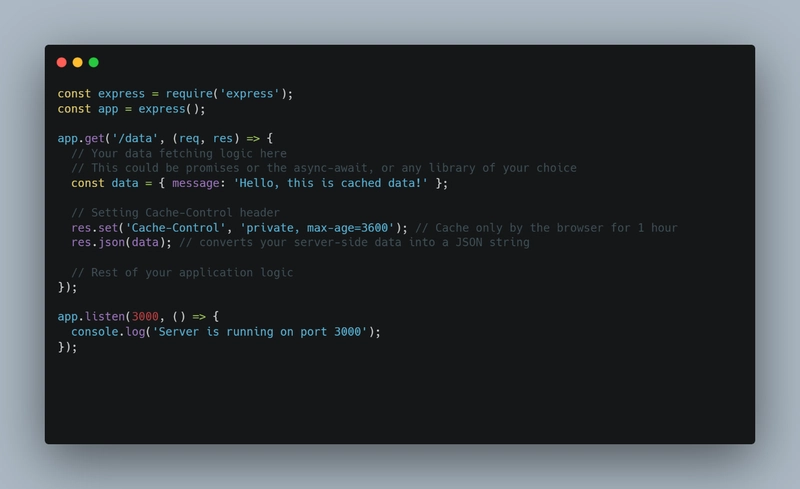

O Cache-Control é, sem dúvida, o cabeçalho mais poderoso e versátil para gerenciar o cache HTTP. Ele permite definir políticas detalhadas sobre como as respostas devem ser cacheadas. Você pode especificar se uma resposta é pública, ou seja, pode ser armazenada por qualquer cliente ou proxy, ou privada, restrita apenas ao navegador do usuário final. Além disso, o diretiva max-age=<segundos> é crucial, definindo o tempo exato que a resposta permanece válida antes de precisar ser revalidada com o servidor.

Ficar tranquila com o cache é um erro. Um

max-agemal configurado pode servir dados obsoletos. Use com sabedoria!

Cabeçalho ETag

O ETag (Entity Tag) é um identificador único para uma versão específica de um recurso. Funciona como uma impressão digital da resposta. Quando um cliente possui uma cópia cacheada e faz uma nova requisição, ele envia o ETag da sua cópia no cabeçalho If-None-Match. Se o ETag no servidor for o mesmo, significa que o recurso não foi alterado, e o servidor responde com um status 304 Not Modified, economizando banda e processamento. É uma forma elegante de validação condicional.

Cabeçalho Last-Modified

Similar ao ETag, o cabeçalho Last-Modified indica a data e hora exatas em que um recurso foi alterado pela última vez. O cliente pode usar essa informação em requisições subsequentes, enviando o valor no cabeçalho If-Modified-Since. Se a data no servidor for anterior à data enviada pelo cliente, o servidor sabe que o recurso não foi modificado desde então e retorna 304 Not Modified. Essa abordagem é frequentemente usada em conjunto com o ETag para uma validação ainda mais robusta.

Onde o Cache Ocorre?

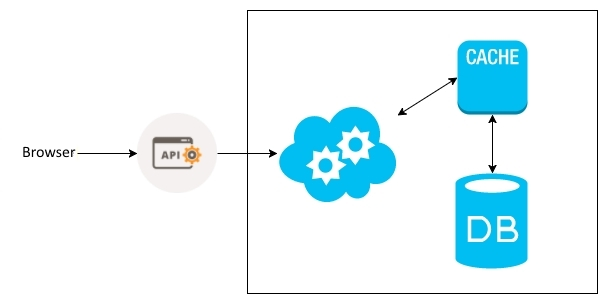

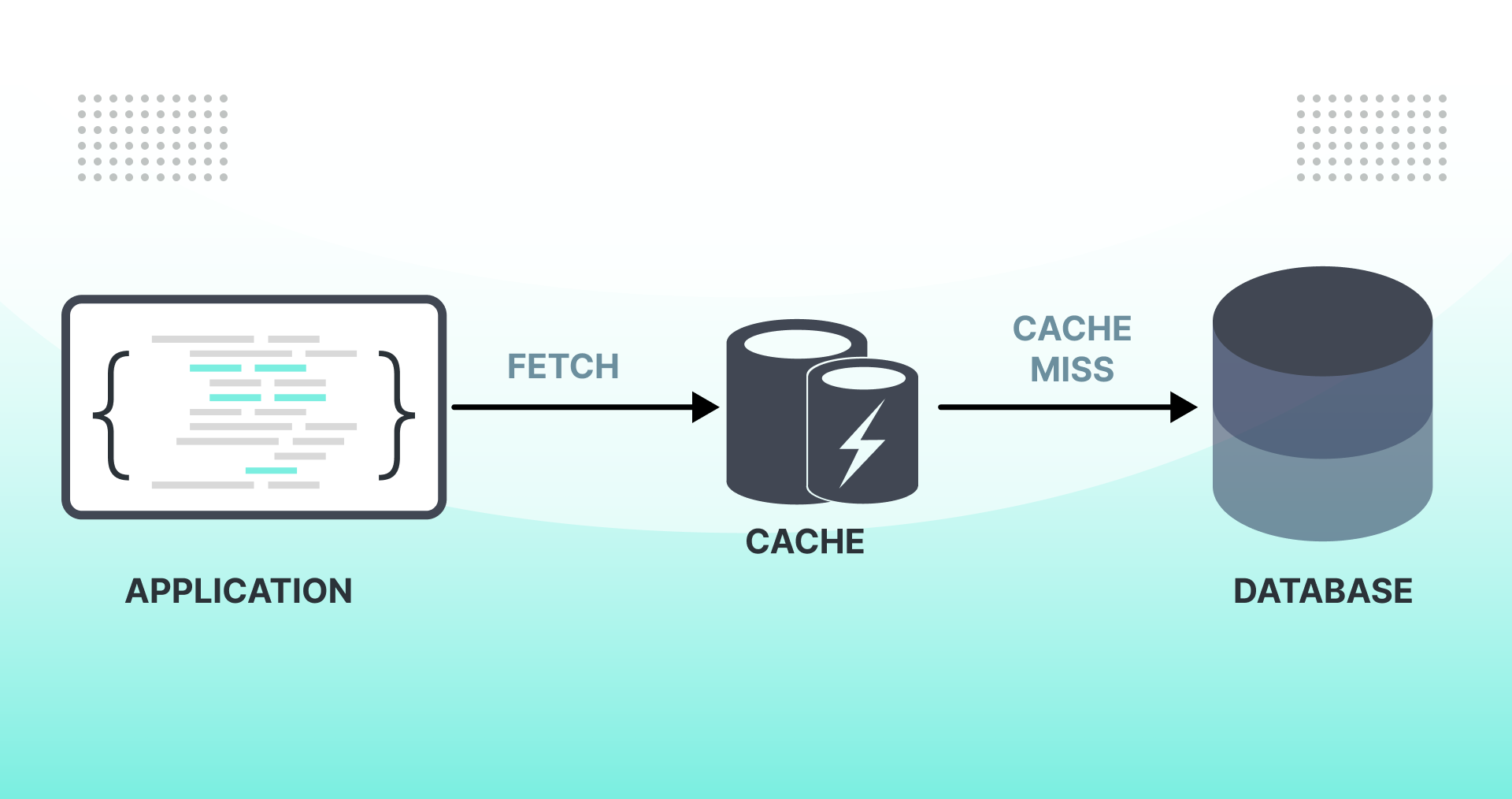

O cache não é um conceito monolítico; ele pode ser implementado em diversas camadas da arquitetura de uma aplicação. Entender esses pontos de armazenamento é vital para planejar sua estratégia de cache de forma abrangente. Cada camada oferece benefícios distintos e pode ser otimizada independentemente ou em conjunto com outras.

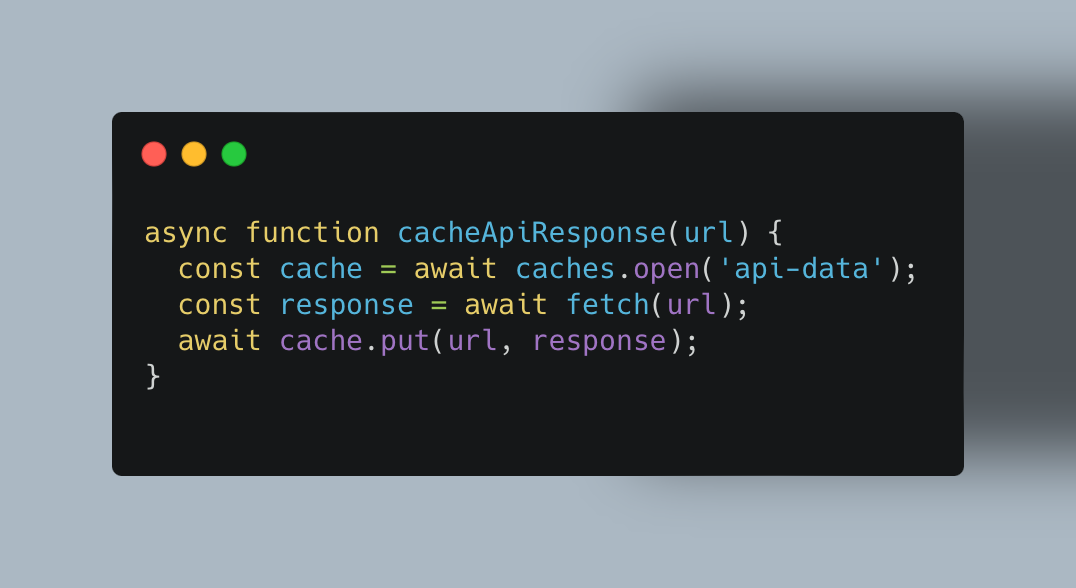

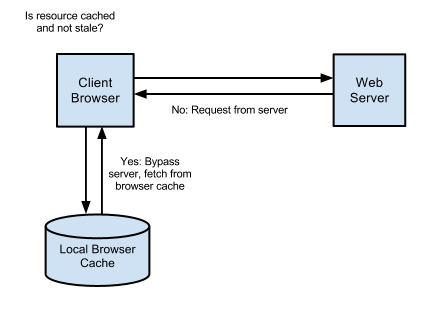

Cache do Lado do Cliente

O Cache do Lado do Cliente, tipicamente o cache do navegador ou de aplicações móveis, é a primeira linha de defesa. Ao armazenar dados localmente no dispositivo do usuário, ele elimina a necessidade de fazer chamadas de rede para recursos que já foram acessados. Isso resulta em tempos de carregamento significativamente mais rápidos para o usuário final, pois os dados são acessados diretamente da memória local, que é muito mais veloz que qualquer conexão de rede.

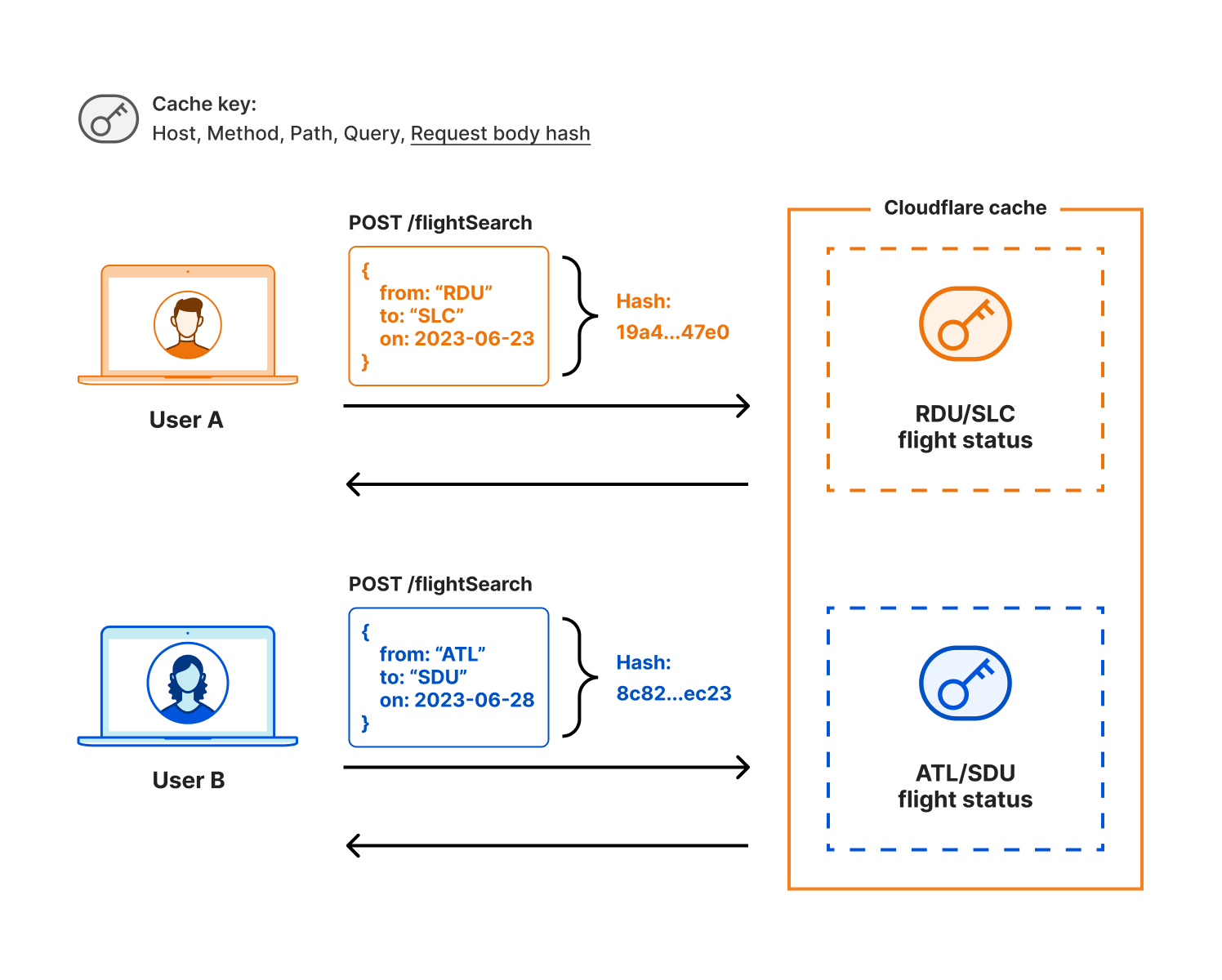

Proxies Intermediários (CDNs/Varnish)

Proxies Intermediários, como as Redes de Distribuição de Conteúdo (CDNs) e softwares como o Varnish, desempenham um papel crucial. Eles armazenam cópias de respostas populares em servidores geograficamente distribuídos. Quando um usuário solicita um recurso, ele é servido pelo proxy mais próximo, reduzindo drasticamente a latência. Além disso, eles aliviam a carga sobre o servidor de origem, pois muitas requisições são atendidas sem sequer chegar a ele.

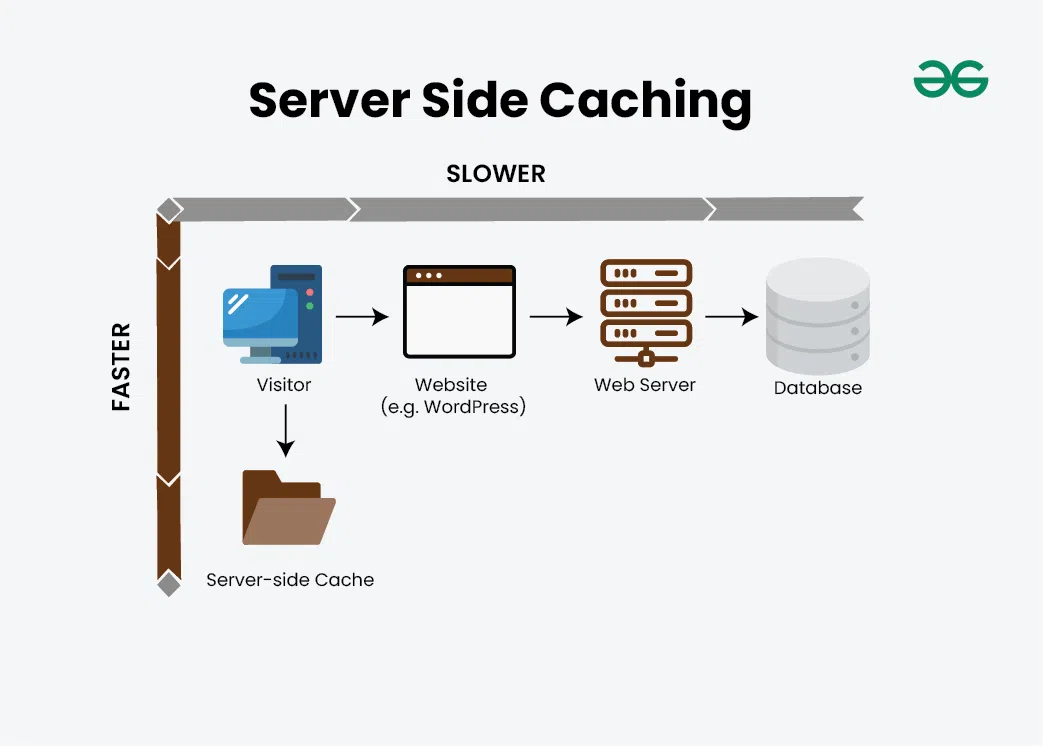

Cache do Lado do Servidor

Para complementar o cache HTTP e ir além, o Cache do Lado do Servidor, utilizando ferramentas como Redis ou Memcached, é essencial. Ele atua dentro da sua própria infraestrutura para armazenar resultados de consultas de banco de dados ou computações complexas. Isso evita que sua aplicação precise acessar o banco de dados repetidamente para os mesmos dados, o que é uma das operações mais lentas em muitas aplicações web.

Benefícios Diretos do Cache HTTP

Os benefícios do cache HTTP são claros e impactantes. A redução de latência é o mais perceptível para o usuário, resultando em uma experiência mais ágil. Para a infraestrutura, a escalabilidade aprimorada é um ganho enorme, pois o servidor consegue atender a um volume maior de requisições com os mesmos recursos. Consequentemente, há uma significativa economia de custos, tanto em banda de rede quanto em poder de processamento, o que se traduz em menor custo operacional.

Vale a Pena? O Veredito do Especialista

Vamos combinar: implementar cache HTTP não é mais um luxo, é uma necessidade para qualquer API que vise alta performance e escalabilidade. Os ganhos em velocidade, eficiência e economia de custos são substanciais e, na minha experiência, superam em muito o esforço de configuração inicial. Ignorar o cache é deixar dinheiro e performance na mesa.

Ao dominar os cabeçalhos como Cache-Control, ETag e Last-Modified, e ao entender onde o cache pode ser aplicado – do cliente aos proxies e ao próprio servidor – você estará apto a construir APIs robustas e rápidas. A otimização de performance de API com cache HTTP é um investimento com retorno garantido para o sucesso da sua aplicação.

Dicas Extras

- Monitore Sempre: Use ferramentas como o Chrome DevTools para inspecionar os cabeçalhos de cache em tempo real. Isso te ajuda a entender como seu cache HTTP está funcionando na prática.

- Validação Condicional é Chave: Sempre que possível, use os cabeçalhos

ETageLast-Modified. Eles evitam que o navegador baixe dados que já possui, economizando banda e acelerando a experiência do usuário. - Atenção ao

Cache-Control: no-cache: Esse valor não significa que o recurso não será cacheado, mas sim que ele precisa ser revalidado com o servidor antes de ser usado. Pode ser útil, mas entenda a diferença para não confundir comno-store(que impede totalmente o cache). - Cache em API Gateway: Se você usa um API Gateway, explore as opções de cache dele. Muitas vezes, o gateway pode cuidar de boa parte da otimização de performance de API com cache HTTP antes mesmo da requisição chegar ao seu serviço.

- Teste em Diferentes Condições: Simule conexões lentas e diferentes dispositivos para ver o impacto real do cache HTTP para performance de API. O que funciona bem em uma rede rápida pode não ser tão eficaz em uma conexão instável.

Dúvidas Frequentes

O que acontece se eu não definir nenhum cabeçalho de cache?

Se nenhum cabeçalho de cache for definido, o comportamento padrão pode variar entre navegadores e proxies. Geralmente, as respostas são tratadas como não-cacheáveis ou com políticas de cache muito restritivas, o que pode não ser o ideal para a performance. É sempre melhor configurar explicitamente as políticas de cache.

Cache HTTP é seguro para dados sensíveis?

Depende. Cabeçalhos como Cache-Control: private instruem o cache a ser usado apenas pelo navegador do usuário, não por caches compartilhados como CDNs. Para dados extremamente sensíveis, a melhor abordagem é evitar o cache completamente ou usar mecanismos de segurança adicionais.

Como implementar cache em APIs REST de forma eficaz?

Para implementar cache em APIs REST, você deve focar em definir corretamente os cabeçalhos Cache-Control, ETag e Last-Modified. Além disso, considere o uso de estratégias de cache do lado do servidor, como Redis ou Memcached, para complementar a otimização de performance de API com cache HTTP.

Conclusão: O Poder do Cache HTTP na Sua API

Dominar o cache HTTP é um passo fundamental para quem busca otimização de performance de API. Ao implementar corretamente as estratégias de cache, você não só melhora a velocidade de resposta, mas também a escalabilidade e a experiência geral do usuário. Explore mais sobre como configurar Cache-Control e ETag em Node.js e estude as melhores práticas e exemplos de cache de API para aprimorar ainda mais suas aplicações.