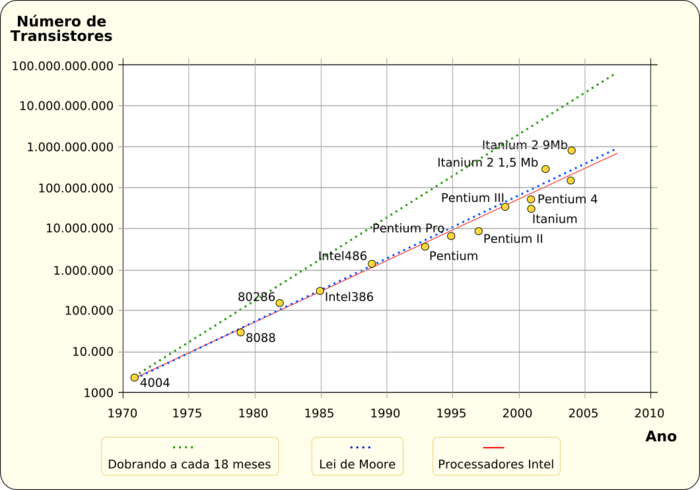

Você sabe como se preparar para o fim da Lei de Moore em 2026? A promessa de computadores cada vez mais rápidos e baratos, impulsionada pela duplicação de transistores a cada dois anos, está chegando ao limite. Essa estagnação, que impacta diretamente o custo e a performance dos chips, exige uma nova estratégia. Fica tranquila, neste post eu vou te mostrar o caminho para otimizar seus recursos e garantir que sua tecnologia continue evoluindo, mesmo sem os saltos automáticos de antes.

O Que a Lei de Moore Realmente Significava para Seu Orçamento de TI e Desempenho?

Por décadas, a Lei de Moore garantiu um ‘almoço grátis’. Significava que, a cada nova geração de hardware, você ganhava mais poder de processamento sem gastar mais. Era um ciclo de melhoria automática para softwares e sistemas.

Essa dinâmica permitia que o avanço tecnológico fosse acompanhado por uma queda consistente nos preços dos componentes. Você sabia que seu investimento em tecnologia renderia mais performance no futuro próximo.

Agora, o cenário muda. Os ganhos automáticos de velocidade de CPU não são mais a regra. Isso força um olhar mais atento para a otimização do código e a arquitetura de sistemas.

“A Lei de Moore, que estabelece que o número de transistores em um chip dobra a cada dois anos, está chegando ao fim, exigindo uma transição da dependência de hardware bruto para a inovação em eficiência de software e novas arquiteturas de computação.”

O Fim da Lei de Moore: Uma Nova Era na Computação Chegou

A Lei de Moore, aquela observação que nos acostumou a ver o poder de processamento dobrando a cada dois anos, está, para todos os efeitos práticos, chegando ao seu limite. Não se trata de um fim abrupto, mas de uma desaceleração clara. Pois é, o ritmo frenético de miniaturização e duplicação de transistores em chips, impulsionado pela indústria de semicondutores por décadas, enfrenta barreiras físicas e de eficiência energética que não podem mais ser ignoradas. O que isso significa para você e para o futuro da tecnologia? Significa que os dias de ganhos automáticos de velocidade de CPU, o famoso “almoço grátis” na computação, estão contados. Agora, a atenção se volta para o refinamento, a especialização e a busca por novas fronteiras. Vamos entender o que está acontecendo e como você pode se preparar para essa transição.

Essa mudança de paradigma exige uma nova abordagem. Em vez de simplesmente esperar que o hardware fique mais rápido por si só, precisamos pensar em como otimizar o software, como usar hardware especializado de forma mais inteligente e como explorar tecnologias completamente novas. O impacto é profundo, afetando desde o desenvolvimento de aplicativos até o planejamento de infraestrutura de TI nas empresas. A era da computação está entrando em um novo capítulo, e ele promete ser tão excitante quanto desafiador.

| Aspecto | Detalhe |

| Observação Original | Número de transistores em um chip dobra aproximadamente a cada dois anos. |

| Desafios Atuais | Limitações físicas (tamanho dos átomos) e problemas de eficiência energética. |

| Consequência Principal | Fim dos ganhos automáticos de velocidade de CPU; necessidade de otimização de código. |

| Impacto Econômico | Preços de chips podem parar de cair drasticamente; aumento do custo de planejamento de TI. |

| Novas Direções | Hardware especializado, computação neuromórfica, quântica e otimização de software. |

O Fim da Lei de Moore: Contexto e Implicações

A Lei de Moore, proposta por Gordon Moore em 1965, foi uma profecia autorrealizável que guiou a indústria de semicondutores por décadas. A ideia central é que a complexidade dos circuitos integrados, medida pelo número de transistores, dobraria a cada período de tempo, inicialmente um ano e depois ajustado para dois. Isso trouxe avanços inimagináveis, tornando os computadores mais poderosos, menores e mais acessíveis. Contudo, a física tem suas leis, e chegamos a um ponto onde os transistores estão se aproximando do tamanho de átomos. A eficiência energética se tornou um gargalo crítico; simplesmente colocar mais transistores em um espaço menor gera calor excessivo e consome energia de forma insustentável.

O fim do “almoço grátis” na computação significa que não podemos mais contar com a simples evolução linear do hardware para obter melhor desempenho. O CEO da Nvidia já sinalizou que os preços dos chips podem continuar subindo, impactando diretamente o planejamento financeiro de TI. Para nós, profissionais e entusiastas, isso exige uma mudança de mentalidade: performance agora vem de design inteligente, não apenas de mais poder bruto.

Estratégias de Otimização e Eficiência de Software

Com o hardware atingindo seus limites, a otimização de software se torna a nova fronteira para extrair o máximo de desempenho. Isso vai muito além de escrever um código que funcione; trata-se de escrever um código que seja excepcionalmente eficiente. Para você, isso significa mergulhar em técnicas de programação de baixo nível, entender como o processador executa suas instruções e como a memória é acessada. O foco muda de “fazer funcionar” para “fazer funcionar da maneira mais rápida e com o menor consumo de recursos possível”.

A busca por eficiência se manifesta em diversas frentes. Vamos explorar algumas delas:

- Refinamento de algoritmos: Escolher ou desenvolver algoritmos com menor complexidade computacional.

- Gerenciamento de memória: Técnicas como alocação e desalocação eficientes, cache-awareness.

- Paralelismo e Concorrência: Utilizar múltiplos núcleos de processamento de forma eficaz.

- Otimização de compilação: Ajustar flags do compilador para arquiteturas específicas.

- Programação assíncrona: Melhorar a responsividade e o uso de recursos em I/O-bound tasks.

- Vectorização (SIMD): Processar múltiplos dados com uma única instrução.

- Redução de overhead: Minimizar chamadas de função e alocações desnecessárias.

- Perfilamento de código: Identificar gargalos de performance com ferramentas especializadas.

- Otimização de loops: Técnicas como loop unrolling e tiling.

- Uso de estruturas de dados eficientes: Escolher a estrutura certa para cada problema.

- Compilação Just-In-Time (JIT): Otimizações dinâmicas durante a execução.

- Compilação Ahead-Of-Time (AOT): Otimizações feitas antes da execução.

- Otimização de I/O: Buffering, acesso sequencial vs. aleatório.

- Redução do consumo de energia: Otimizar para performance por watt.

- Testes de performance contínuos: Integrar medições de desempenho no ciclo de desenvolvimento.

- Abstrações de custo: Entender o impacto real de abstrações de alto nível.

- Otimização de rede: Minimizar latência e tráfego.

- Compressão de dados: Reduzir o tamanho de dados para transferência e armazenamento.

- Serialização eficiente: Formatos como Protocol Buffers ou FlatBuffers.

- Code generation inteligente: Gerar código otimizado em tempo de execução ou build.

- Otimização de UI/UX: Garantir que a interface responda rapidamente.

- Gerenciamento de estado: Otimizar como o estado da aplicação é mantido.

- Uso de bibliotecas otimizadas: Aproveitar código de terceiros já performático.

- Evitar bloqueios desnecessários: Garantir que threads não fiquem esperando mais do que o preciso.

- Otimização de consultas de banco de dados: Índices, planos de execução.

- Cache de dados: Armazenar resultados de operações custosas.

- Lazy loading: Carregar dados apenas quando são realmente necessários.

- Otimização de renderização gráfica: Técnicas de culling, LOD.

- Gerenciamento de threads: Pool de threads, afinidade de CPU.

- Redução de dependências: Minimizar acoplamento entre módulos.

- Otimização de acesso a hardware: Drivers e interações diretas.

- Uso de linguagens de baixo nível: C, C++, Rust para partes críticas.

- Abordagem de programação funcional: Imutabilidade pode simplificar paralelismo.

- Otimização de expressões regulares: Evitar padrões complexos e ineficientes.

- Code obfuscation vs. performance: Separar preocupações.

- Análise de dependência de dados: Para paralelismo e otimização de cache.

- Otimização de chamadas de sistema: Minimizar a troca de contexto.

- Uso de memória compartilhada: Para comunicação inter-processos eficiente.

- Padrões de design para performance: Ex: Flyweight, Object Pool.

- Otimização de serialização/desserialização: Em sistemas distribuídos.

- Gerenciamento de recursos: Liberação oportuna de arquivos, conexões.

- Otimização de algoritmos de ordenação e busca: Dependendo do volume e características dos dados.

- Uso de hardware específico: Ex: GPUs para tarefas paralelas massivas.

- Refatoração contínua: Melhorar o código ao longo do tempo.

- Minimizar o uso de reflexão: Em linguagens que a suportam.

- Otimização de formatação de strings: Especialmente em loops.

- Gerenciamento de eventos: Assíncrono e eficiente.

- Otimização de caminhos críticos: Identificar e otimizar as partes do código mais executadas.

Adoção de Hardware Especializado para Desempenho

Se o hardware de propósito geral não vai mais dobrar de performance a cada dois anos, a solução é usar hardware especializado para tarefas específicas. Isso já vem acontecendo com as GPUs (Unidades de Processamento Gráfico) sendo usadas para machine learning e computação científica, muito além de seus propósitos gráficos originais. A tendência é a proliferação de processadores customizados, otimizados para cargas de trabalho particulares, como inteligência artificial, criptografia, processamento de vídeo e muito mais. Para você, isso significa entender quais tipos de hardware são mais adequados para os problemas que você precisa resolver.

Vamos pensar em exemplos práticos de como o hardware especializado pode ser a chave:

- Unidades de Processamento Gráfico (GPUs): Ideais para paralelismo massivo, como em deep learning, simulações científicas e renderização.

- Field-Programmable Gate Arrays (FPGAs): Circuitos reconfiguráveis que podem ser adaptados para tarefas específicas, oferecendo alta performance e eficiência energética para workloads customizados.

- Application-Specific Integrated Circuits (ASICs): Chips projetados para uma única função, como em mineração de criptomoedas ou em processadores de IA dedicados, oferecendo máxima performance e eficiência para essa tarefa.

- Unidades de Processamento Neural (NPUs): Hardware otimizado para cargas de trabalho de inteligência artificial e machine learning, executando redes neurais de forma muito mais rápida e eficiente que CPUs tradicionais.

- Processadores de Sinal Digital (DSPs): Especializados em processamento de sinais em tempo real, úteis em telecomunicações, áudio e controle.

- Aceleradores de Criptografia: Hardware dedicado para acelerar operações criptográficas, como criptografia de chave pública e hash.

- Controladores de Rede Programáveis: Para processamento de pacotes de rede em alta velocidade em equipamentos de rede.

- Processadores de Mídia: Otimizados para codificação e decodificação de vídeo e áudio.

- Hardware para Computação de Borda (Edge Computing): Dispositivos compactos e eficientes projetados para processamento de dados localmente, reduzindo a latência.

- Aceleradores de Banco de Dados: Hardware que pode acelerar operações específicas de bancos de dados, como junções e agregações.

Explorando Tecnologias Emergentes: Computação Quântica e Neuromórfica

Olhando para o futuro, duas áreas se destacam como promessas para superar as limitações atuais: a computação quântica e a computação neuromórfica. A computação quântica, utilizando princípios da mecânica quântica como superposição e emaranhamento, tem o potencial de resolver problemas que são intratáveis para computadores clássicos, como otimização complexa, descoberta de medicamentos e criptoanálise. Embora ainda em estágios iniciais e com desafios técnicos significativos, seu potencial é revolucionário.

Por outro lado, a computação neuromórfica busca imitar a estrutura e o funcionamento do cérebro humano. Esses chips, ao invés de processar dados sequencialmente, operam de forma mais paralela e adaptativa. A grande vantagem aqui é a eficiência energética: estudos indicam ganhos de até 1000x em eficiência para certas tarefas. Essa abordagem é particularmente promissora para aplicações de inteligência artificial e aprendizado de máquina em tempo real, onde o consumo de energia é uma grande preocupação, especialmente em dispositivos móveis e sistemas embarcados.

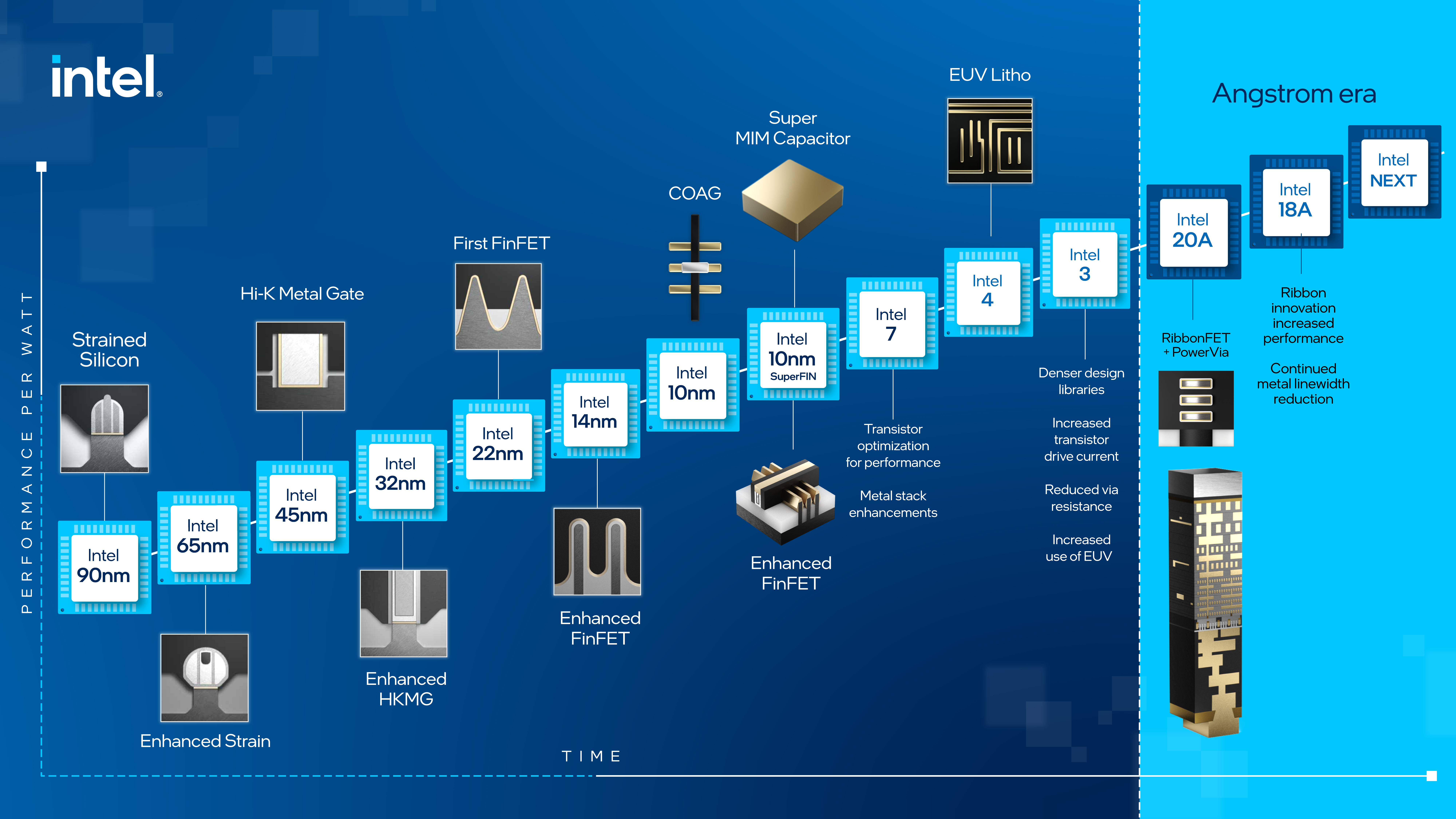

Novos Materiais e o Futuro da Fabricação de Chips

As limitações físicas impostas pelo silício como material semicondutor principal estão impulsionando a pesquisa em novos materiais. Cientistas estão explorando alternativas como o grafeno, nanotubos de carbono e outros materiais 2D que prometem condutividade superior, menor consumo de energia e a capacidade de criar transistores ainda menores. Além dos materiais, novas arquiteturas de transistores, como os Transistores de Gate-All-Around (GAAFETs), já estão substituindo os FinFETs para permitir a miniaturização contínua.

A fabricação em si também está evoluindo. Técnicas mais avançadas de litografia, como a litografia ultravioleta extrema (EUV), são essenciais para imprimir padrões incrivelmente finos nos wafers de silício. A inovação em materiais e processos de fabricação é fundamental para continuar empurrando os limites do que é possível, mesmo que o ritmo da Lei de Moore tradicional não seja mais sustentável. Estamos vendo um esforço concentrado para encontrar materiais que ofereçam melhor desempenho e eficiência energética, abrindo caminho para a próxima geração de chips.

Adaptação da Mentalidade Econômica e Planejamento de TI

O fim da trajetória de queda constante nos preços dos chips, prevista pela Lei de Moore, tem implicações econômicas diretas. O planejamento de TI, que por anos se beneficiou da expectativa de hardware mais barato e mais potente a cada ciclo de atualização, precisa ser revisto. Empresas podem precisar investir mais em otimização de software e em hardware especializado, em vez de simplesmente esperar que a próxima geração de servidores ou desktops resolva seus problemas de performance.

Para você, isso significa que a previsibilidade de custos pode mudar. O TCO (Custo Total de Propriedade) de sistemas de TI pode aumentar se não houver uma estratégia clara. É crucial priorizar a eficiência e a longevidade do hardware existente, investir em habilidades de otimização de código e avaliar cuidadosamente o ROI (Retorno sobre Investimento) de novas tecnologias. A era da obsolescência programada acelerada pelo avanço da Lei de Moore pode dar lugar a um ciclo de vida de hardware mais longo, focado em maximizar o valor do que já se possui.

O Futuro é Agora: Preparado para a Evolução?

O fim da Lei de Moore não é um ponto final, mas um convite à inovação. A computação está entrando em uma fase de diversificação e especialização. A boa notícia é que as alternativas e as novas abordagens prometem um futuro excitante, com computadores capazes de resolver problemas ainda mais complexos e de forma mais eficiente. Para você, isso representa uma oportunidade única de se aprofundar em áreas como otimização de software, arquiteturas de hardware emergentes e novas paradigmas de computação.

A adaptação a essa nova realidade exige proatividade. Investir em aprendizado contínuo, experimentar novas tecnologias e repensar as estratégias de desenvolvimento e infraestrutura são passos fundamentais. O futuro da computação não depende mais apenas de colocar mais transistores em um chip, mas de como usamos a inteligência, a criatividade e as ferramentas disponíveis para construir sistemas cada vez mais capazes e eficientes. A jornada pós-Lei de Moore já começou, e estar preparado é o seu maior trunfo.

Dicas Extras

- Foco em Otimização de Software: Com o fim dos ganhos automáticos de performance em CPUs, o refinamento do código se torna essencial. Invista em técnicas de programação mais eficientes e profilers para extrair o máximo de cada ciclo de processamento.

- Explore Hardware Especializado: A era pós-Lei de Moore valoriza arquiteturas sob medida. Familiarize-se com GPUs, TPUs, ASICs e FPGAs, entendendo como eles podem acelerar tarefas específicas em seus projetos.

- Aprofunde-se em Novos Materiais: Pesquisas em materiais como grafeno e outras alternativas ao silício prometem revolucionar a fabricação de chips. Acompanhar esses avanços pode dar uma vantagem estratégica.

- Considere a Computação Neuromórfica: Essa abordagem, inspirada no cérebro, oferece ganhos de eficiência energética impressionantes. Entender seus princípios pode abrir portas para soluções inovadoras em IA e processamento de dados.

Dúvidas Frequentes

O que acontece se a Lei de Moore realmente acabar?

Se a Lei de Moore chegar ao fim, os ganhos exponenciais no número de transistores e, consequentemente, na velocidade dos processadores, não serão mais garantidos. Isso significa que a indústria de TI precisará buscar outras formas de inovação para continuar avançando em performance e eficiência, como o desenvolvimento de hardware especializado e a otimização de software.

Como o fim da Lei de Moore afeta o custo dos computadores?

Historicamente, a Lei de Moore permitiu que o custo dos chips caísse enquanto o desempenho aumentava. Com seu fim, podemos ver os preços dos chips pararem de cair tão rapidamente ou até mesmo aumentarem, impactando o planejamento financeiro de empresas e o custo de dispositivos para o consumidor final. A busca por novas tecnologias de fabricação e materiais se torna crucial para mitigar esse efeito.

Quais são as alternativas tecnológicas que surgem com o fim da Lei de Moore?

Diversas frentes tecnológicas estão emergindo como potenciais sucessoras ou complementos. A computação quântica promete resolver problemas complexos de forma inédita. A computação neuromórfica foca em eficiência energética para tarefas de IA. Além disso, o desenvolvimento de hardware especializado (como GPUs e TPUs) e a exploração de novos materiais para chips são caminhos promissores para superar os limites atuais do silício.

Conclusão: Adaptando-se ao Novo Cenário Tecnológico

O fim da Lei de Moore não é um ponto final, mas sim um convite à inovação. A indústria de TI está em um momento de transição, onde a criatividade e a expertise serão ainda mais valorizadas. Preparar-se significa olhar além do óbvio, explorando novas arquiteturas de hardware e aprofundando o conhecimento em otimização de software. A computação quântica e a computação neuromórfica são apenas duas das muitas avenidas que se abrem, prometendo um futuro excitante e desafiador para todos nós.